美洽的客服软渠道数据统计覆盖渠道分布、访客与会话量、响应时长、首次响应率、会话解决率、自动化率、多语言覆盖与客户满意度等核心指标,按日、周、月分层汇总,结合语言与地域维度对比,使用时间序列与漏斗分析来衡量趋势与转化,并把抽样质检、工单打标与用户反馈结合,形成可操作的优化建议和自动化策略评估。持续

什么是客服软渠道数据统计(说清楚就好)

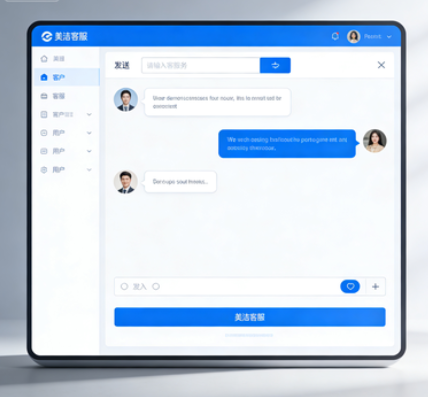

先把名词弄清楚:*软渠道*通常指在线的客户接触点——网站在线客服、移动端嵌入聊天、社媒私信、应用内聊天窗等。数据统计,就是把这些接触点产生的访客行为、会话流、人工与自动化交互,都量化成指标,便于判断服务效率和用户体验。说白了,就是把“聊天”变成可以比对、优化、回溯的数据。

核心指标(必须跟踪的)

- 渠道分布:各渠道(Web/APP/社媒/邮件等)占比,反映流量与投入匹配度。

- 访客数(UV)与会话数:访客数是独立用户,会话数是访客发起的交互次数。二者比值常用于评估复访与互动率。

- 首次响应时长(FRT):从用户发起到客服(人工或机器人)首次发送响应的时间。公式:FRT = Σ(首次响应时间)/会话数。

- 首次响应率:在目标时段内按SLA有响应的会话占比(例如30秒内响应率)。

- 会话解决率(CRR, Conversation Resolution Rate):单次会话内问题被解决的比例。常用两种口径:会话内自评或后续无重复问题。

- 自动化率:通过机器人或自动化流程完成服务的会话占比(含全自动解决与机器人引导转人工前的自动响应比例)。

- 多语言覆盖率:支持的语言种类与各语言会话占比,评估语言能力是否与市场匹配。

- 客户满意度(CSAT / NPS):直接的体验指标,常与FRT、解决率做关联分析。

- 人工工时/人效:人均会话数、平均处理时长(AHT)等,衡量人工队伍效率。

常用计算公式(便于落地)

- FRT(平均首次响应时长) = 总首次响应时长 ÷ 会话数

- 首次响应率(SLA) = 符合SLA的会话数 ÷ 总会话数

- 会话解决率 = 已解决会话数 ÷ 已关闭会话数

- 自动化率 = 自动完成会话数 ÷ 总会话数

- 多语言覆盖率(某语言) = 该语言会话数 ÷ 总会话数

数据采集与清洗要点(别被噪声骗了)

这里很容易出纰漏,所以列几个实务要点:

- 统一会话ID:不同渠道上同一访客的多条交互要做会话聚合,避免重复计数。

- 时区与时间窗:所有时间戳统一到UTC或产品所在主时区,报表按日周月时要注意边界问题。

- 去重与机器人区分:将系统消息、心跳包、自动翻译中间件的消息过滤出去;同时标注机器人与人工的交互节点。

- 多语言检测:对话语言应通过显式字段或自动检测标注,误判会严重影响语言覆盖统计。

- 事件与标签化:对关键事件(如“转人工”、“发起退款记录”、“问题标注”)打标签,便于后续漏斗分析与关联分析。

如何构建报表与看板(实操视角)

我通常会把看板做成三层:实时、日度概览与深度分析,这样既能预警也能跟踪趋势。

看板切片建议

- 总体概览:会话数、访客数、FRT(均值/中位数)、会话解决率、CSAT、自动化率。

- 渠道维度:每个渠道的会话数、FRT与解决率,标注增长或下降。

- 语言/地域维度:语言覆盖、某语言的FRT与CSAT差异。

- 人工与自动化比:转人工率、机器人成功自解率。

- 异常预警:单日FRT突然上升或CSAT急降触发告警。

示例数据表(用于说明,不代表美洽真实数据)

| 渠道 | 会话数 | 访客数 | 首次响应时长(s) | 首次响应率(30s) | 会话解决率 | 自动化率 | CSAT |

| 网站在线 | 12,345 | 9,876 | 22 | 82% | 68% | 45% | 4.3/5 |

| 移动APP | 8,210 | 7,000 | 18 | 86% | 72% | 50% | 4.5/5 |

| 社媒私信 | 4,500 | 4,200 | 120 | 35% | 60% | 20% | 3.9/5 |

常见分析场景与计算示例(一步步来)

举几个具体的、常会遇到的场景:

1)检出响应瓶颈

步骤:按小时拆分FRT,查看峰值时段;与入站会话量、在线工位数做关联。如果FRT在12:00-13:00从20s飙升到120s,同时工位数不变,那就是峰值队列压力,需要临时增援或自动化分流。

2)评估机器人效果

比较有机器人介入与无机器人介入时的转人工率、会话解决率和CSAT:若机器人介入后自动化率提升,但CSAT下降,说明机器人策略需要优化(比如误判或话术冷淡)。

3)多语言覆盖影响销量

把语言维度的会话解决率与该语言区域的转化率(下单或留资)做关联,发现某语言的FRT长、解决率低时,转化率通常也低,这提示需要强化该语言的支持或本地化话术。

落地优化策略(可立刻用的操作项)

- 优先降低FRT:把SLA按渠道设定(比如社媒需更短响应),并通过优先级路由、快速回复模板、机器人首问抓取等方式削峰填谷。

- 提升机器人自解率:用真实会话训练意图模型,定期回炉被转人工的机器人回答作为训练样本,关注误判率。

- 分流与能力匹配:对话路由到具备对应语言或产品线知识的坐席,减少二次转接。

- 打标与知识库闭环:每次人工解决的问题应打上标签并同步到知识库,供机器人和其他坐席复用。

- 跟踪体验链路:把CSAT与FRT、解决率按用户旅程关联,找出影响体验的关键节点。

质量保障、治理与数据可靠性

数据好坏直接影响决策,所以要做三件事:

- 抽样质检:定期对标注为“已解决”的会话做人工抽样检查,校验是否真的解决。

- 版本与事件变更管理:任何话术、机器人或前端事件变更都应写入变更日志,便于对指标变动进行因果回溯。

- 异常检测:在看板中加入异常检测规则(如FRT超过历史均值2σ自动报警),并形成处置流程。

项目落地建议与KPI阶梯(实务路线图)

我通常把项目拆成三期,省时省力还见效快:

- 第1期(0–4周)——基础打通:统一事件埋点,搭建基础看板,确保FRT、会话数、解决率可监测,做1–2个快赢(如常见问自动应答)。

- 第2期(1–3个月)——深度优化:训练机器人、构建语言模型、分渠道话术优化,开始AB测试模板与机器人策略。

- 第3期(3–6个月)——闭环与自动化:把抽样质检、知识库同步、工单打标形成闭环,自动化率与CSAT并重,形成持续改进机制。

常见陷阱与注意事项(别踩雷)

- 只看平均值不看分布:平均FRT看起来好看,但长尾会影响大量用户。

- 把自动化率当万能解:自动化提高了效率,但若CSAT下降,就不是好事。

- 忽视渠道差异:社媒和网站的用户预期差异大,统一SLA会导致体验错配。

- 数据埋点变更不记录:会导致前后数据不可比,判断失误。

最后一点——如何让数据产生动作

数据的价值在于让团队做出改变。把报表做成“决策报表”:每个关键指标旁写上可落地的“下一步动作”(例如,FRT次日异常:临时增加1人手并启动机器人快速回复模板),并把责任人和截止时间写清楚。这样,报表不是看了就忘,而是变成日常运营的触发器。

就先写到这儿,想着还能补一点经验术语和小技巧,但又怕信息太满,反正有些细节是在实施过程中慢慢摸索出来的——需要我把某一部分展开成操作手册时,随时说一声。